霍金再发警告 人工智能将统治地球(2)

2017-02-23 9:22

来源:邪恶报

作者:佚名

霍金认为,随着人们科学技术水平的日益上升,导致未来人工智能得到的信息技术会愈发强大。而未来人工智能可能会以生化战争或核子战争的方式摧毁人类。人类唯一的办法,就是运用其逻辑与理性去控制这个可能即将到来的灾难。

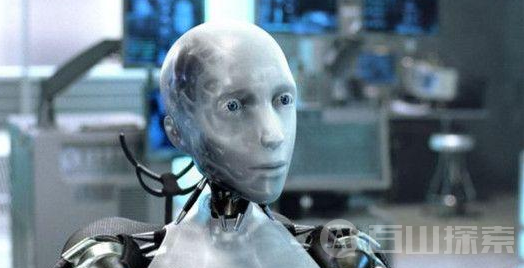

网图

霍金还说,当这些人工智能开始学会了思考或是有了自己的“智慧”以后,地球毁灭也只是时间问题。不可否认的是,现阶段的人工智能科技带给人们非常多的好处,对于人们非常有利,人们也热衷于去开发它并且依赖它。但就是人类的这种懒惰和贪婪的心理,未来将会导致我们走向灭亡。

网图

霍金在一次采访中曾说过这样一段话:我说的人工智能将会摧毁人类,并不是他们拥有着常人不可能拥有的智慧或者想法,而是当他们的信息高度发达的时候,如果它们做一件事的目标和人类预期的目标发生冲突,那么人类的噩梦就要开始了。霍金觉得如果现在人们还不能看清未来,不能为未来做好最坏打算,建立相对于人工智能更好的管理办法,人类最终会败给人工智能,而这只不过是时间问题。

上一篇:上一篇:男孩因妈妈怀二胎离家出走

下一篇:下一篇:外星人无力入侵地球 距离和速度是大问题

相关文章

最新专题

更多专题...

热门专题

- 啪啪啪

- 女人图片黄一点图片

- 自慰

- 舔老婆

- 车震

- 马赛克

- 欧美

- 野战

- 真实

- xxoogif

- 美女被

- 肉图

- 办公室

- 39秒

- 不看后悔

- 有声

- 声音

- 狂射

- 无遮无挡

- 男上女下

- 狂日

- 贼好笑

- 强姧

- 男的和女的啪啪啪

- 嘿咻嘿咻

- 操逼

- 叉女人

- 大吴哥

- 出处

- qq天空网

- 邪恶吧

- 没内涵

- 大奶子

- 李毅吧

- 搞笑吧

- 后式入

- 动态图片吧

- 美女动态啪啪图

- 做嗳啪啪啪视频图

- 糗

- 口交

- 性绞

- 做爱

- 做僾

- 做艾

- 36D

- 天堂

- 成人gif

- av

- 潮吹

- 涩涩

- 揉胸

- 另类

- 黄色

- 福利

- 爱爱图片

- 后入式

- 27报

- 嘿咻

- 男女做爱

- h动态图

- 色你妹

- xxoo

- 撸管

- 露b

- 男人叉女人

- 卵蛋网

- 哈哈mx

- 性插图

- 电车痴汉

- 前入式

- 动态图

- 做爱动态图

- 啪啪

- 美女动态啪啪图

- 啪啪啪动态图

- 动图

- 美女动态图

- 操逼视频

- 美女动态

- 男女啪啪啪

- 邪恶的天堂

- 啪啪啪啪动态图

- 拍拍拍

- 啪啪啪动态

- 口绞姿动态图

- 邪恶萝莉

- 福利图

- av动态图

- 家教小故事

- caobi

- 女人自熨图片

- 邪恶gif动态图

- 黄色美女

- 邪恶动态图吸奶

- 邪恶美女

- 美女操逼

- 黄图片

- 叉叉叉

- 叼嘿

- 美女爱爱

- 女性图片

- 彩色漫画

- 动态美女图片

- gif出处高清视频

- gif动图

- 52kk

- 涩涩爱得得撸夜夜

- 动态插图很黄图片

- 27报

- xxoo

- 100经典出处gif动态图

- 邪恶gif

- 邪恶动态图27

- 操逼图

- 动态图出处及番号2017

- 美女动态图片

- 插图

- 邪恶动态图27报

- 美女做爱图片

- 啪啪啪gif

- gif邪恶动态图

- 口绞姿动态图

- 日比

- 邪恶帮

- 办公室诱惑

- 叉叉

- 028nb

- 黄色照片

- 邪恶动态图后式入叉

- 真人做爱

- 我爱爆

- 福利图片

- 干美女

- 福利动态图

- h动态图

- 动态黄图

- 美女口交

- xxoogif

- 爱爱图片全部过程图片

- 办公室偷吻

- 动态色图

- 邪恶少女漫画无翼鸟mhkk

- 操b图片

- 后进式

- 男女图片

- 美女自慰图片

- 美女黄色图片

- 美女自慰图

- 奶子图片

- 日本后式入动态图

- 邪恶动态图第五十七期

- xxo

- 邪恶集

- 邪恶动漫

- 邪恶古堡

- 邪恶色系漫画

- 邪恶少女

- 邪恶帝

- 邪恶爱

- 邪恶漫画无翼鸟

- 邪恶漫画大全

- 邪恶漫画基地

- 内涵漫画

- 色系军团

- 卡列漫画

- 幻啃漫画

- 美乳

- 美臀

- 黑丝

- 车模

- 裸身

- 粉嫩

- 比基尼

- 床照

- 空姐

- 超短裙

- 情趣内衣

- 白嫩

- 街拍

- 萝莉

- 少女

- 非主流

- 韩国

- 尤物

- 自拍

- 私房

- 长发

- 浴室

- 湿身

- 真空

- 时尚

- Cosplay

- 日本

- 巨乳

- 校花

- 古典

- 推女神

- 御姐

- 旗袍

- 学生妹

- AV女优

- 足球宝贝

- 网袜

- 丁字裤

- 熟女

- 白丝

- 人体艺术

- 腿模

- 台湾

- 短发

- 气质

- 少妇

- 女仆装

- 高跟

- 护士

- 女神

- 写真

- 性感

- 妹子

- 爆乳

- 情趣

- 大尺度

- 制服

- 清纯

- 酥胸

- 嫩模

- 翘臀

- 正妹

- 丰满

- 胸部

- 风骚

- 湿身

- 大奶

- 大波

- 长腿

- 可爱

- 小清新

- 学生

- 养眼

- 丝袜

- 胸器

- 童颜

- 透视

- 一字马

- 萌妹子

- 软妹子

- 主播

- 女仆

- 裸体

- 包养

- 后背摇

- 社会摇

- 丰臀

- 丰乳

- 纤腰

- 泳衣

- 女神撸

- 真实自拍

- 女警

- 快手福利视频

- 黑丝美腿

- 皮裤

邪恶搞笑热点

-

1

世界上往往有许多事无法解释,或许是因为现在我们的科学水平还比较低,无法解释。比如有些人会拥有一些我们无法理解的能力,甚至他们自己也无法解释。无论大人还是孩子,都非...详细>>

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11